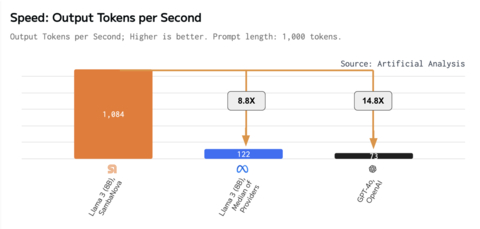

SambaNova Systems, l’entreprise spécialisée dans les solutions d’IA générative qui propose les modèles les plus rapides et les puces les plus puissantes, est le grand vainqueur de la dernière étude comparative d’Artificial Analysis sur les grands modèles de langage (LLM). En tête de classement avec plus de 1000 jetons par seconde, Samba-1 Turbo établit un nouveau record de performance avec Llama 3 8B.

Ce communiqué de presse contient des éléments multimédias. Voir le communiqué complet ici : https://www.businesswire.com/news/home/20240529380179/fr/

“SambaNova’s Samba-1 Turbo has set a new record for large language model inference performance in recent benchmarking by Artificial Analysis. » Micah Hill-Smith, Co-Founder & CEO of Artificial Analysis. (Image source: Artificial Analysis)

« Notre mission est de donner à chaque entreprise un système d’IA personnalisé à moindre coût », a déclaré Rodrigo Liang, CEO et fondateur de SambaNova. « Une vitesse d’inférence ultra-rapide qui ne compromet pas la précision, voilà de quoi les développeurs ont besoin pour mettre la puissance d’un LLM personnalisé à portée de leur entreprise afin de rationaliser les flux de travail et innover plus rapidement ».

Micah Hill-Smith, co-fondateur et CEO d’Artificial Analysis a déclaré : « Le Samba-1 Turbo de SambaNova a établi un nouveau record de performances d’inférence de grands modèles de langage lors d’une récente analyse comparative réalisée par Artificial Analysis.

Artificial Analysis a évalué de manière indépendante les performances de Samba-1 Turbo sur Llama 3 Instruct (8B) de Meta à 1 084 jetons de sortie par seconde, soit une vitesse plus de 8 fois plus rapide que celle de sortie médiane des fournisseurs que nous évaluons. Artificial Analysis a pu vérifier que Llama 3 Instruct (8B) sur Samba-1 Turbo atteint des scores de qualité conformes à une précision de 16 bits.

Les nouvelles frontières de la vitesse d’inférence des modèles de langage ouvrent de nouvelles voies à la création d’applications d’IA. Parmi les nouveaux cas d’utilisation, citons les agents qui effectuent des actions en différentes étapes, tout en maintenant une conversation harmonieuse, des expériences vocales en temps réel et l’interprétation de documents en grande quantité ».

Contrairement à ses concurrents, qui font fonctionner le même modèle sur des centaines de puces, Samba-1 Turbo exécute Llama 3 8B à 1 000 jetons par seconde (t/s) sur seulement 16 puces, et peut héberger simultanément jusqu’à 1 000 points de contrôle Llama3 sur un seul nœud SN40L à 16 sockets. Il s’agit de la vitesse la plus rapide pour servir Llama 3, tout en conservant une précision absolue et à un coût bien moindre que chez ses concurrents. Le concurrent le plus proche a besoin de centaines de puces pour exécuter une seule instance de chaque modèle en raison des limitations de la capacité de mémoire, et les GPU offrent un débit total et une capacité de mémoire plus faibles. SambaNova peut exécuter des centaines de modèles sur un seul nœud tout en conservant cette vitesse record, ce qui permet de diviser par 10 le coût total de possession par rapport à la concurrence.

« La vitesse de Samba-1 Turbo illustre cette merveille de Dataflow, qui rationalise le mouvement des données sur les puces SN40L, en minimisant la latence et en maximisant le débit de traitement. Il est supérieur au GPU : le résultat est une IA instantanée », a déclaré Kunle Olukotun, cofondateur de SambaNova Systems et informaticien de renom à l’université Stanford.

Testez Samba-1 Turbo dès aujourd’hui !

À propos de SambaNova Systems

Les clients se tournent vers SambaNova pour déployer rapidement des capacités d’IA de pointe afin de répondre aux exigences d’un monde propulsé par l’IA. La plateforme évolutive d’IA de notre entreprise est le pilier technologique de la nouvelle génération de l’IA informatique. Nous donnons la possibilité à nos clients d’exploiter les informations commerciales précieuses contenues dans leurs données. Notre offre phare, SambaNova Suite, dépasse les limites des anciennes technologies pour alimenter les grands modèles de fondation complexes qui permettent aux clients de découvrir de nouveaux services et flux de revenus, et de stimuler l’efficacité opérationnelle.

Basée à Palo Alto, en Californie, SambaNova Systems a été fondée en 2017 par des sommités de l’industrie et des experts en conception matérielle et logicielle de Sun/Oracle et de l’université Stanford. Parmi les investisseurs, citons SoftBank Vision Fund 2, des fonds et des comptes gérés par BlackRock, Intel Capital, GV, Walden International, Temasek, GIC, Redline Capital, Atlantic Bridge Ventures, Celesta, et plusieurs autres. sambanova.ai – info@sambanova.ai – Linkedin – X

Note de bas de page : Artificial Analysis propose une analyse indépendante des modèles de langage d’IA et des fournisseurs d’API. L’entreprise fournit des analyses comparatives et des informations connexes qui aident les personnes et les entreprises à choisir le bon modèle adapté à leur cas d’utilisation et le fournisseur à utiliser pour ce modèle.

Le texte du communiqué issu d’une traduction ne doit d’aucune manière être considéré comme officiel. La seule version du communiqué qui fasse foi est celle du communiqué dans sa langue d’origine. La traduction devra toujours être confrontée au texte source, qui fera jurisprudence.

Consultez la version source sur businesswire.com : https://www.businesswire.com/news/home/20240529380179/fr/